Eine der größten KI-Firmen hat eine besondere Job-Ausschreibung veröffentlicht: Gesucht wird ausgerechnet ein Experte für u. a. Waffen. Dahinter steckt jedoch keine Aufrüstung, sondern eine wachsende Sorge vor dem Missbrauch der hauseigenen KI.

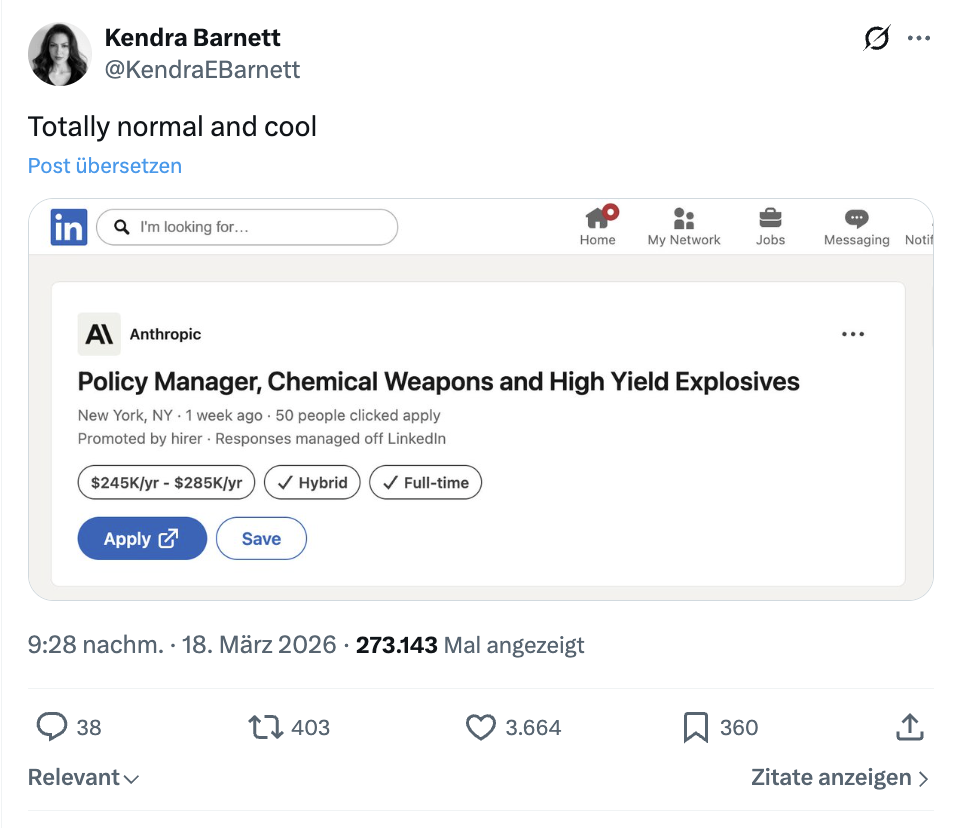

Was genau wurde ausgeschrieben? Die KI-Firma Anthropic, bekannt für ihren Chatbot Claude, sucht einen „Policy Manager“ für chemische Waffen und hochexplosive Stoffe.

Der Job klingt zunächst etwas ungewöhnlich, allerdings ist der Kontext entscheidend: Es geht nicht darum, Waffen zu entwickeln, sondern darum, zu verhindern, dass KI dabei hilft.

Weitere Berichte bestätigen, dass solche Experten gebraucht werden, um sogenannte „Guardrails“ zu bauen. Unter „Guardrails“ (dt.: Leitplanken) versteht man Schutzmechanismen, die einen Rahmen vorgeben und gefährliche Anfragen blockieren (Yahoo-News & BBC).

Laut Informationen des Tech-Magazins Mashable soll die gesuchte Person dabei helfen, ebensolche Regeln und Schutzmechanismen zu entwickeln, damit KI-Systeme nicht missbraucht werden können. Im Fokus steht dabei die Herstellung von Waffen oder Sprengstoffen.

Zum Schutze aller

Warum braucht eine KI plötzlich Waffenexperten? Der Hintergrund ist ein wachsendes Problem: KI-Modelle werden immer leistungsfähiger und damit auch potenziell gefährlich. Anthropic selbst hat seine Richtlinien bereits kürzlich verschärft. Die Nutzung von KI zur Entwicklung von:

- chemischen Waffen

- biologischen Waffen

- nuklearen oder radiologischen Waffen

- hochwirksamen Sprengstoffen

ist inzwischen ausdrücklich verboten (Verge & Anthtopic).

Parallel dazu sollen Expertinnen und Experten verschiedener Fachbereiche nun sicherstellen, dass die KI auch in der Praxis zuverlässig erkennt, wann Nutzer versuchen, gefährliche Inhalte zu erzeugen.

Wie real ist die Gefahr durch KI und Waffen? Forschungsergebnisse zeigen bereits heute, dass moderne KI-Systeme komplexe wissenschaftliche Prozesse verständlich aufbereiten können – darunter auch solche, die missbraucht werden könnten. Große Sprachmodelle können ohne Sicherheitsmechanismen theoretisch dabei helfen, Wissen zu chemischen oder biologischen Stoffen zugänglicher zu machen (Cornell University).

Anthropic selbst spricht davon, dass ihre Modelle missbraucht werden könnten, um „schwere Verbrechen“ zu ermöglichen, wenn Schutzmechanismen versagen würden (Axios).

Gleichzeitig wird in den USA aktuell intensiv darüber diskutiert, wie KI im Militär eingesetzt werden darf. Während Behörden und das Pentagon verstärkt auf autonome Systeme setzen, positionierte sich Anthropic bisweilen bewusst vorsichtig.

Laut Nachrichtenagentur Reuters kam es sogar zu Spannungen mit der US-Regierung, weil das Unternehmen bestimmte militärische Anwendungen – etwa autonome Waffensysteme – kritisch sieht und nicht uneingeschränkt unterstützen will.

Dario Amodei, CEO von Anthropic, selbst betont in mehreren Interviews und Stellungnahmen vor allem eines: KI müsse strikt kontrolliert werden, insbesondere wenn es um militärische Nutzung oder autonome Systeme gehe (CBS News via Reddit).

KI-Modelle können mitunter ganz neue Gefahrenpotenziale bieten, die Missbrauch in vielen Bereichen ermöglichen – darunter auch Waffenbesitz. Neben all den Gefahren bieten breit zugängliche Sprachmodelle wie ChatGPT und Claude auch viele Vorteile: Ein Mann verkauft sein Haus, lässt sich von ChatGPT sagen, wie er die Wände streichen soll: „Erwartungen übertroffen“

Deine Meinung ist uns wichtig!

Gefällt dir der Artikel? Hast du irgendwelche Kommentare? Sag uns, was du denkst!

Bitte lies unsere Kommentarregeln, bevor du kommentierst.

„Laut Nachrichtenagentur Reuters kam es sogar zu Spannungen mit der US-Regierung, weil das Unternehmen bestimmte militärische Anwendungen – etwa autonome Waffensysteme – kritisch sieht und nicht uneingeschränkt unterstützen will.“

…anders als die ehemalige NonProfit Organisation ChatGPT, die sich dem Kriegstreiber Hegseth und dem US Militär an den Hals geworfen hatte, als Claude eine Anpassung ihrer KI, an militärische Prämissen, ablehnte und von denen auf die Blacklist gesetzt wurde. Der Aspekt, das man stärkere Bemühungen anstrebt, Barrieren zu implementieren, ist spannend.